05/05/2026

Rezumat: Dezvoltarea accelerată a sistemelor de inteligență artificială (AI) exercită o presiune structurală asupra arhitecturii tradiționale a răspunderii civile, concepută într-un context în care raportul dintre faptă, autor și prejudiciu era, în mod esențial, direct și identificabil. Apariția unor sisteme capabile să proceseze autonom volume masive de date și să genereze decizii cu impact juridic sau economic semnificativ determină o relativizare a conceptelor clasice de vinovăție, imputabilitate și cauzalitate.

Prezentul demers își propune să analizeze în ce măsură mecanismele consacrate de Codul civil al României pot fi utilizate pentru acoperirea prejudiciilor generate de inteligența artificială, în lipsa unui regim juridic autonom pe deplin conturat. În acest context, sunt examinate principalele forme de răspundere civilă – delictuală, contractuală și pentru lucruri – din perspectiva adecvării lor la specificul tehnologic al AI, precum și limitele funcționale ale acestora în situații caracterizate prin opacitate algoritmică și autonomie decizională.

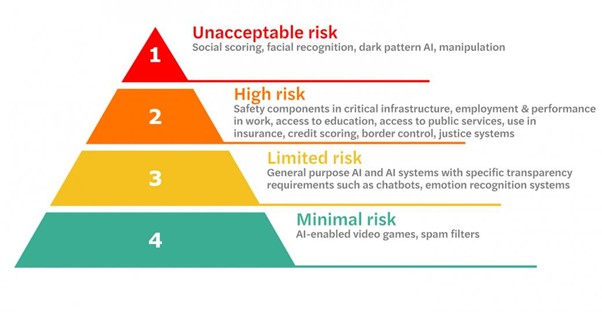

Totodată, analiza vizează identificarea actorilor potențial responsabili în lanțul de producere și utilizare a sistemelor AI – dezvoltatori, furnizori de date, operatori și intermediari digitali – evidențiind dificultățile de delimitare a sferei de răspundere în cadrul unor ecosisteme tehnologice complexe și interdependente. În paralel, sunt evaluate tendințele de reglementare la nivelul Uniunii Europene, în special prin raportare la Regulamentul privind inteligența artificială, care propune o abordare bazată pe evaluarea riscurilor și pe instituirea unor obligații diferențiate în funcție de impactul sistemelor AI.

Instituția răspunderii civile s-a edificat, în mod tradițional, pe premisa existenței unei fapte imputabile unei persoane determinate, în cadrul unui raport juridic în care autorul prejudiciului poate fi identificat, iar conduita sa evaluată prin raportare la criterii precum culpa sau intenția. Această construcție, consacrată și sistematizată în Codul civil al României, presupune o relație relativ clară între faptă, autor și consecința prejudiciabilă.

Emergența și dezvoltarea accelerată a sistemelor de inteligență artificială fragilizează însă această premisă clasică, generând o veritabilă mutație de paradigmă. Astfel, în contextul utilizării AI:

În aceste condiții, dificultatea majoră nu rezidă în constatarea existenței unui prejudiciu – adesea evident și cuantificabil – ci în identificarea subiectului de drept căruia îi poate fi imputată, în mod legitim, producerea acestuia. Problema juridică se deplasează, astfel, de la analiza conduitei individuale la evaluarea unui lanț tehnologic distribuit, în care intervin dezvoltatori, furnizori de date, operatori și utilizatori, fiecare contribuind, în mod diferit, la rezultatul final.

Această transformare impune o reconsiderare a fundamentelor răspunderii civile, în sensul adaptării criteriilor de imputare și al redefinirii noțiunii de control juridic asupra instrumentelor tehnologice, pentru a asigura menținerea funcției esențiale a acestei instituții: repararea integrală a prejudiciului și protecția efectivă a persoanei vătămate.

2.1. Răspunderea delictuală

Modelul clasic al răspunderii delictuale, consacrat de Codul civil al României, presupune întrunirea cumulativă a unor condiții bine definite: existența unei fapte ilicite, producerea unui prejudiciu, stabilirea unei legături de cauzalitate între faptă și prejudiciu, precum și vinovăția autorului. Acest cadru conceptual funcționează eficient în ipoteza unor conduite umane identificabile, susceptibile de a fi evaluate prin raportare la standarde de diligență și prudență.

În materia inteligenței artificiale, însă, aplicarea acestor exigențe întâmpină dificultăți structurale, generate de specificul tehnologic al sistemelor implicate. În primul rând, vinovăția devine dificil de individualizat, întrucât decizia prejudiciabilă nu mai poate fi atribuită unei intenții sau unei culpe în sens clasic, ci rezultă dintr-un proces algoritmic autonom, care nu reflectă în mod direct conduita psihică a unei persoane. Chiar și în ipoteza identificării unui actor uman (dezvoltator, operator), legătura dintre conduita acestuia și rezultatul produs de AI este adesea indirectă și mediată tehnologic.

În al doilea rând, proba raportului de cauzalitate este profund afectată de opacitatea algoritmică. Sistemele de tip „black box” limitează accesul la logica decizională internă, ceea ce face dificilă demonstrarea faptului că un anumit rezultat prejudiciabil este consecința directă a unei erori sau deficiențe specifice. În lipsa unei transparențe suficiente, analiza cauzalității riscă să rămână la un nivel probabilistic, incompatibil, în anumite situații, cu standardele probatorii tradiționale.

În fine, expertiza tehnică devine indispensabilă, însă nu întotdeauna concludentă. Complexitatea modelelor AI, caracterul lor dinamic și dependența de volume mari de date pot conduce la opinii divergente sau la imposibilitatea stabilirii unor concluzii ferme, ceea ce afectează previzibilitatea soluțiilor judiciare.

În aceste condiții, deși răspunderea delictuală rămâne, în principiu, aplicabilă și oferă un cadru teoretic pentru angajarea răspunderii, eficiența sa este diminuată din perspectivă probatorie. Aceasta tinde să devină un instrument dificil de utilizat în practică, în absența unor adaptări legislative sau jurisprudențiale care să țină seama de particularitățile tehnologiei AI.

2.2. Răspunderea pentru lucruri

Extinderea noțiunii de „lucru”, în sensul consacrat de Codul civil al României, permite includerea sistemelor de inteligență artificială în sfera mecanismelor de răspundere pentru lucruri, printr-o interpretare evolutivă adaptată realităților tehnologice. În acest cadru, fundamentul răspunderii nu mai este vinovăția, ci paza juridică a lucrului, înțeleasă ca putere de direcție, control și utilizare în interes propriu.

Astfel, răspunderea revine persoanei care exercită această pază juridică, de regulă utilizatorul sau operatorul sistemului AI, independent de dovedirea unei culpe. Accentul se deplasează, în mod semnificativ, de la analiza conduitei subiective la relația obiectivă dintre persoană și instrumentul tehnologic, precum și la beneficiul pe care aceasta îl obține din utilizarea sistemului. Această abordare răspunde unei nevoi de eficiență practică, facilitând repararea prejudiciului prin simpla dovedire a raportului dintre lucru și producerea acestuia.

Avantajul principal al acestei soluții constă în caracterul său pragmatic și funcțional, fiind deja valorizată în doctrină și regăsită, în mod implicit sau explicit, în practica judiciară, ca mecanism de adaptare a dreptului clasic la noile tehnologii. Ea permite evitarea dificultăților probatorii specifice răspunderii delictuale, în special în ceea ce privește vinovăția și, parțial, cauzalitatea.

Totuși, această construcție prezintă limite evidente. În primul rând, ea tinde să simplifice excesiv realitatea tehnologică, reducând complexitatea ecosistemului AI la o relație binară între „lucru” și „paznic”. În al doilea rând, ignoră sau marginalizează contribuția altor actori esențiali, precum dezvoltatorii sau furnizorii de date, ale căror decizii pot influența decisiv comportamentul sistemului. În consecință, plasarea integrală a răspunderii asupra utilizatorului poate conduce la soluții inechitabile, în special în ipoteza în care acesta nu deține un control efectiv asupra mecanismelor interne ale AI.

Prin urmare, deși răspunderea pentru lucruri reprezintă, în prezent, una dintre cele mai viabile soluții de drept pozitiv, aceasta are un caracter provizoriu și necesită completări normative care să reflecte natura distribuită a riscurilor asociate inteligenței artificiale.

2.3. Răspunderea contractuală

În cadrul raporturilor contractuale, utilizarea sistemelor de inteligență artificială nu determină, în principiu, o derogare de la regulile generale consacrate de Codul civil al României în materia răspunderii contractuale. Dimpotrivă, mecanismele clasice își păstrează aplicabilitatea, chiar dacă sunt puse în fața unor situații tehnice noi.

Astfel, partea care recurge la utilizarea unui sistem AI în executarea obligațiilor sale nu se poate exonera de răspundere invocând autonomia sau imprevizibilitatea acestuia. Din punct de vedere juridic, inteligența artificială este asimilată unui instrument de executare, similar altor mijloace tehnice sau umane, iar alegerea și utilizarea sa intră în sfera de control și responsabilitate a debitorului. Eventualele deficiențe ale sistemului, erori de funcționare sau rezultate neconforme sunt, în consecință, imputabile celui care l-a integrat în mecanismul de executare contractuală.

În ipoteza unei neexecutări sau a unei executări necorespunzătoare, se angajează răspunderea contractuală clasică, cu toate consecințele sale: obligația de reparare a prejudiciului, eventual plata de daune-interese și, după caz, alte remedii specifice (rezoluțiune, reducerea prestației etc.). Din această perspectivă, AI nu constituie o cauză exoneratoare, în lipsa unor împrejurări care să se circumscrie noțiunii de forță majoră sau altor cauze legale de exonerare, condiții dificil de îndeplinit în contextul utilizării unor sisteme tehnologice previzibile ca risc.

Prin urmare, inteligența artificială este tratată, în plan contractual, ca un instrument aflat sub controlul debitorului, iar riscurile inerente utilizării sale sunt integrate în sfera obligațiilor asumate. Această soluție asigură stabilitatea și previzibilitatea raporturilor juridice, însă transferă în mod semnificativ riscul tehnologic asupra părții care utilizează AI, ceea ce poate genera, în anumite situații, necesitatea unor mecanisme contractuale de repartizare a acestui risc (clauze de limitare a răspunderii, garanții, asigurări etc.).

3.1. Dezvoltatorul

În arhitectura juridică a răspunderii pentru prejudiciile generate de inteligența artificială, dezvoltatorul ocupă o poziție centrală, în măsura în care acesta proiectează, antrenează și configurează sistemul, stabilind parametrii inițiali ai funcționării sale. Din această perspectivă, răspunderea sa poate fi angajată pentru o serie de deficiențe care țin de faza de concepție și implementare tehnică.

Astfel, dezvoltatorul poate răspunde pentru:

În plan juridic, poziția dezvoltatorului este adesea analizată prin analogie cu regimul răspunderii pentru produse defecte, consacrat de Codul civil al României și de legislația specială. Această analogie permite fundamentarea răspunderii independent de existența unei culpe dovedite, prin raportare la lipsa siguranței pe care utilizatorul sau publicul o poate aștepta în mod legitim.

Cu toate acestea, analogia prezintă limite semnificative. Spre deosebire de produsele clasice, sistemele AI nu sunt entități statice, ci sisteme dinamice, capabile să evolueze după introducerea pe piață, prin mecanisme de învățare continuă. Această caracteristică face dificilă delimitarea momentului în care produsul poate fi considerat „defect”, precum și atribuirea exclusivă a răspunderii dezvoltatorului pentru comportamente emergente, care nu erau previzibile la momentul proiectării.

În consecință, deși dezvoltatorul rămâne un actor esențial în configurarea răspunderii civile, angajarea responsabilității sale trebuie realizată într-un cadru mai nuanțat, care să țină seama de caracterul evolutiv al sistemelor AI și de interdependența acestuia cu ceilalți participanți la lanțul tehnologic.

3.2. Utilizatorul / operatorul

În practică, utilizatorul sau operatorul sistemului de inteligență artificială se conturează ca principalul candidat la angajarea răspunderii civile, în considerarea poziției sale funcționale în lanțul de utilizare a tehnologiei. Această orientare este determinată de mai mulți factori relevanți din punct de vedere juridic.

În primul rând, utilizatorul exercită controlul imediat asupra sistemului, fiind cel care îl activează, îl configurează în parametri operaționali și îl integrează într-un anumit flux decizional sau economic. În al doilea rând, acesta determină contextul concret al utilizării, inclusiv scopul, limitele și condițiile în care AI este utilizată, aspecte esențiale pentru evaluarea riscurilor. Nu în ultimul rând, utilizatorul este, de regulă, în poziția de a preveni sau limita producerea prejudiciului, fie prin supraveghere, fie prin intervenție umană sau prin alegerea unor sisteme adecvate nivelului de risc.

Din aceste considerente, plasarea răspunderii în sarcina utilizatorului apare ca o soluție eficientă și compatibilă cu logica dreptului civil, inclusiv prin prisma conceptului de pază juridică a lucrului reglementat de Codul civil al României. Ea permite identificarea rapidă a unui subiect responsabil și facilitează repararea prejudiciului.

Totuși, această soluție nu este lipsită de critici. În anumite situații, utilizatorul nu deține un control real asupra mecanismelor interne ale sistemului AI, în special în cazul unor tehnologii complexe, opace sau furnizate „ca serviciu” (AI as a Service). Autonomia decizională a sistemului, combinată cu lipsa accesului la logica algoritmică, poate transforma utilizatorul într-un simplu intermediar tehnologic, fără capacitatea efectivă de a anticipa sau influența rezultatele.

În aceste condiții, atribuirea integrală a răspunderii în sarcina utilizatorului riscă să conducă la soluții inechitabile, prin transferul unui risc tehnologic disproporționat asupra unei persoane care nu controlează în mod substanțial cauza prejudiciului. Această realitate impune, în perspectivă, o reconfigurare a criteriilor de imputare, în sensul unei distribuiri mai echilibrate a răspunderii între actorii implicați.

3.3. Furnizorii de date

În ecosistemul inteligenței artificiale, furnizorii de date ocupă un rol esențial, adesea subestimat din perspectivă juridică, deși datele constituie materia primă pe baza căreia sistemele AI sunt antrenate și își fundamentează deciziile. Calitatea, acuratețea și reprezentativitatea acestor date influențează în mod direct comportamentul algoritmic, putând determina rezultate conforme sau, dimpotrivă, prejudiciabile.

Astfel, bias-ul (părtinirea) sau erorile din seturile de date pot genera consecințe negative semnificative, inclusiv discriminări, decizii incorecte sau evaluări eronate în contexte sensibile (financiar, medical, juridic). În aceste situații, prejudiciul nu rezultă neapărat dintr-o defecțiune tehnică a sistemului, ci dintr-o deficiență structurală a datelor utilizate, care alterează logica decizională a AI.

Cu toate acestea, angajarea răspunderii furnizorilor de date este deosebit de dificilă. Principala problemă rezidă în complexitatea lanțului cauzal, întrucât datele sunt, de regulă:

În aceste condiții, stabilirea unei legături directe între o anumită deficiență a datelor și prejudiciul produs devine problematică, atât sub aspect probator, cât și conceptual. În plus, furnizorii de date nu dețin, de regulă, control asupra modului concret în care datele sunt utilizate ulterior de dezvoltatori sau operatori, ceea ce complică evaluarea imputabilității.

Prin urmare, deși furnizorii de date pot avea o contribuție determinantă la producerea prejudiciului, cadrul juridic actual, inclusiv cel derivat din Codul civil al României, nu oferă instrumente suficiente pentru angajarea facilă a răspunderii acestora. Această lacună evidențiază necesitatea unor mecanisme normative care să recunoască explicit rolul datelor în generarea riscurilor și să permită o distribuire mai echitabilă a răspunderii în lanțul tehnologic.

3.4. Platformele digitale

Rolul platformelor digitale în ecosistemul inteligenței artificiale cunoaște o evoluție semnificativă, de la o poziție tradițională de simplu intermediar tehnic la aceea de actor activ, cu influență reală asupra modului de funcționare și utilizare a sistemelor AI. Această transformare are implicații directe asupra configurării răspunderii civile.

În primul rând, platformele exercită un control semnificativ asupra accesului și distribuției tehnologiilor bazate pe AI, stabilind condițiile în care acestea sunt puse la dispoziția utilizatorilor, precum și regulile de utilizare. Prin politici interne, termeni și condiții sau mecanisme de moderare, acestea pot influența în mod direct riscurile asociate utilizării sistemelor.

În al doilea rând, în numeroase situații, platformele dispun de posibilitatea de intervenție asupra algoritmilor, fie prin configurare, optimizare, actualizare sau chiar suspendare. Acest nivel de control depășește sfera unei simple intermedieri tehnice și apropie platformele de o poziție de co-autor sau, cel puțin, de participant activ la procesul decizional algoritmic.

Pe acest fond, se conturează, în special la nivelul Uniunii Europene, o tendință de extindere a răspunderii platformelor digitale, în acord cu creșterea rolului și influenței acestora. Inițiativele legislative și orientările jurisprudențiale urmăresc depășirea modelului clasic de exonerare a intermediarilor, în favoarea unei abordări care ține seama de gradul efectiv de control și implicare.

Această evoluție reflectă o schimbare de paradigmă: platformele nu mai pot invoca în mod automat neutralitatea tehnologică, în măsura în care participă activ la configurarea și funcționarea sistemelor AI. În consecință, ele devin potențiali subiecți ai răspunderii civile, într-un cadru juridic în continuă transformare, care încearcă să adapteze principiile tradiționale la realitățile economiei digitale.

Prin Regulamentul privind inteligența artificială și inițiativele legislative conexe, Uniunea Europeană conturează un cadru normativ complex, orientat spre gestionarea riscurilor generate de sistemele AI și adaptarea mecanismelor juridice la specificul acestora. Abordarea europeană se distinge prin caracterul său preventiv și prin încercarea de a corela dezvoltarea tehnologică cu exigențele protecției juridice.

Un element central al acestei reglementări îl reprezintă clasificarea sistemelor AI în funcție de nivelul de risc, ceea ce permite aplicarea unor regimuri juridice diferențiate. Astfel, sistemele considerate de risc ridicat (high-risk) sunt supuse unor cerințe stricte privind:

În acest context, se urmărește instituirea unor obligații consolidate pentru operatorii și dezvoltatorii de sisteme AI de risc ridicat, menite să reducă probabilitatea producerii de prejudicii și să faciliteze identificarea cauzelor în cazul unor incidente.

De asemenea, un obiectiv esențial al cadrului european îl constituie facilitarea accesului la probe pentru persoanele prejudiciate, în vederea depășirii dificultăților generate de opacitatea algoritmică. În acest sens, sunt avute în vedere mecanisme care să permită accesul la informații relevante privind funcționarea sistemelor AI, inclusiv prin obligații de documentare și transparență impuse operatorilor.

Totodată, Uniunea Europeană urmărește realizarea unui echilibru între stimularea inovării și protecția drepturilor fundamentale, evitând atât suprareglementarea, cât și lăsarea necontrolată a unor tehnologii cu impact semnificativ asupra societății.

În planul răspunderii civile, dezbaterile actuale vizează inclusiv instituirea unor forme de răspundere obiectivă pentru anumite categorii de sisteme AI, în special cele de risc ridicat, precum și posibila inversare a sarcinii probei în favoarea victimei. Aceste soluții ar reprezenta o adaptare substanțială a principiilor clasice, în scopul asigurării unei protecții efective și al distribuirii echitabile a riscurilor tehnologice.

5.1. Cauzalitatea

Unul dintre pilonii răspunderii civile îl constituie existența unei legături de cauzalitate certe și directe între faptă și prejudiciu. În cazul sistemelor de inteligență artificială, această cerință este profund afectată de structura tehnologică a procesului decizional. Lanțul cauzal nu mai este liniar, ci fragmentat și distribuit între mai mulți actori și etape (colectarea datelor, antrenarea modelului, implementarea, utilizarea concretă).

În consecință, stabilirea unei relații directe între o anumită conduită și prejudiciul produs devine dificilă, uneori imposibilă în termenii tradiționali ai probei juridice. Această realitate pune sub semnul întrebării adecvarea criteriilor clasice din Codul civil al României, care presupun o cauzalitate suficient de clară pentru angajarea răspunderii.

5.2. Opacitatea algoritmică

Multe sisteme AI funcționează pe baza unor modele complexe, caracterizate printr-un grad ridicat de opacitate decizională („black box”). Această lipsă de transparență limitează accesul la logica internă a algoritmului și face dificilă reconstituirea raționamentului care a condus la un anumit rezultat.

Din perspectivă juridică, opacitatea afectează nu doar analiza cauzalității, ci și dreptul la un proces echitabil, întrucât partea prejudiciată poate fi pusă în imposibilitatea de a înțelege și contesta efectiv mecanismul care a generat prejudiciul. În absența unor obligații de transparență și explicabilitate, se creează un dezechilibru probator între părți.

5.3. Autonomia tehnologică

Pe măsură ce sistemele AI devin tot mai autonome, capacitatea acestora de a genera rezultate fără intervenție umană directă ridică probleme fundamentale în materia imputabilității. Modelul clasic al răspunderii civile se bazează pe ideea că prejudiciul poate fi atribuit unei persoane care a acționat sau a omis să acționeze în mod culpabil.

În cazul AI, însă, decizia este rezultatul unui proces autonom, ceea ce conduce la o diluare a legăturii dintre voința umană și rezultatul produs. În aceste condiții, criteriile tradiționale de imputare (culpa, intenția) devin insuficiente, fiind necesară o reconfigurare a acestora în funcție de noile realități tehnologice.

5.4. Dispersia responsabilității

Ecosistemul AI implică o pluralitate de actori – dezvoltatori, furnizori de date, operatori, platforme – fiecare contribuind, în mod diferit, la funcționarea sistemului. Această multiplicitate a intervenienților conduce la o dispersie a responsabilității, în care niciun actor nu deține, în mod exclusiv, controlul asupra rezultatului final.

Riscul major este acela al unei diluări a răspunderii, în care dificultatea identificării unui responsabil clar afectează în mod direct dreptul victimei la repararea prejudiciului. În lipsa unor mecanisme juridice de repartizare coerentă a răspunderii, complexitatea tehnologică poate deveni un obstacol în calea protecției efective a persoanelor prejudiciate.

Analiza limitelor cadrului juridic actual evidențiază necesitatea unor intervenții normative care să adapteze instituțiile răspunderii civile la specificul tehnologic al inteligenței artificiale. În acest sens, se conturează câteva direcții de reformă menite să asigure atât protecția efectivă a persoanelor prejudiciate, cât și menținerea unui climat favorabil inovării.

O primă direcție vizează instituirea unei forme de răspundere obiectivă pentru sistemele AI de risc ridicat, în linie cu orientările desprinse din Regulamentul privind inteligența artificială. O asemenea soluție ar elimina necesitatea dovedirii vinovăției, concentrând analiza asupra existenței prejudiciului și a legăturii cu funcționarea sistemului, ceea ce ar facilita accesul victimelor la reparație.

În strânsă legătură cu aceasta, se impune instituirea obligativității asigurării pentru operatorii de sisteme AI, în special pentru cele cu impact semnificativ. Un mecanism de tip asigurare obligatorie ar permite distribuirea riscurilor tehnologice și ar garanta existența unor resurse financiare pentru acoperirea prejudiciilor, reducând dependența de identificarea și solvabilitatea unui anumit responsabil.

O altă direcție esențială o reprezintă dezvoltarea unor mecanisme de inversare sau flexibilizare a sarcinii probei, menite să corecteze dezechilibrul probator generat de opacitatea algoritmică. În situațiile în care victima nu poate avea acces la informațiile tehnice relevante, ar fi justificată instituirea unor prezumții în favoarea acesteia sau obligarea operatorilor de a furniza dovezi privind conformitatea sistemului.

De asemenea, se impune consacrarea unor standarde obligatorii de transparență și audit algoritmic, care să permită verificarea funcționării sistemelor AI și identificarea eventualelor deficiențe. Aceste standarde ar trebui să includă obligații de documentare, trasabilitate și explicabilitate, în vederea facilitării controlului juridic și tehnic.

Nu în ultimul rând, este necesară o delimitare clară a responsabilităților între actorii implicați – dezvoltatori, furnizori de date, operatori și platforme – prin reglementarea explicită a rolului fiecăruia în lanțul tehnologic. O astfel de clarificare ar contribui la evitarea diluării răspunderii și la asigurarea unei distribuiri echitabile a riscurilor.

În ansamblu, aceste direcții de reformă conturează tranziția de la un model clasic, centrat pe culpă, la un model adaptat riscurilor tehnologice, în care accentul cade pe prevenție, distribuirea riscului și protecția efectivă a victimei.

Dreptul civil actual oferă, fără îndoială, soluții aplicabile în materia prejudiciilor generate de inteligența artificială, în special prin intermediul mecanismelor consacrate de Codul civil al României referitoare la răspunderea pentru lucruri și răspunderea contractuală. Aceste instrumente permit, în practică, identificarea unui subiect responsabil și asigurarea reparării prejudiciului, chiar și în absența unui cadru normativ specializat.

Cu toate acestea, soluțiile existente reprezintă, în esență, adaptări ale unor concepte juridice tradiționale la realități tehnologice noi, și nu un răspuns sistemic, coerent și complet. Ele funcționează prin extensie și analogie, ceea ce le conferă un caracter inevitabil fragmentar și, uneori, imprevizibil.

Inteligența artificială impune, în acest context, o regândire profundă a fundamentelor răspunderii civile, în jurul unor principii directoare clare. În primul rând, protecția victimei trebuie să rămână centrală, astfel încât dificultățile tehnice sau complexitatea sistemelor AI să nu se transforme într-un obstacol în calea reparării prejudiciului. În al doilea rând, este necesară o distribuire echitabilă a riscului tehnologic între actorii implicați, evitând atât concentrarea excesivă a răspunderii asupra unui singur participant (de regulă utilizatorul), cât și diluarea acesteia până la ineficiență. În fine, cadrul juridic trebuie să asigure un echilibru adecvat între încurajarea inovării și menținerea unui nivel adecvat de responsabilitate, astfel încât dezvoltarea tehnologică să nu fie nici inhibată, dar nici lipsită de consecințe juridice.

În absența unei intervenții normative coerente, aliniate inclusiv la evoluțiile europene, practica va continua să opereze prin extensii conceptuale și soluții jurisprudențiale ad-hoc, cu riscul apariției unor interpretări neuniforme și al unei scăderi a previzibilității juridice. În aceste condiții, necesitatea unui cadru reglementar adaptat specificului inteligenței artificiale devine nu doar oportună, ci esențială pentru menținerea echilibrului între tehnologie și drept.

Redactor: P.A.

Copyright © 2026. All rights reserved.